-

"[SK TECH SUMMIT 2023] LLM 적용 방법인 RAG VS PEFT, Domain 적용 승자는?" 영상 리뷰AI/NLP 2024. 5. 21. 20:38728x90

"[SK TECH SUMMIT 2023] LLM 적용 방법인 RAG VS PEFT, Domain 적용 승자는?"

영상 리뷰- 목차

- 1. LLM 배경

- 2. 사내 적용 시 Challenge Point

- 3. PEFT vs RAG

- 4. 결론

- PoC(Proof of Concept)를 진행하며 발견했던 부분들에 대해서 강연 ~

- 새로운 기술, 서비스, 프로젝트, 신약 등이 실현 가능성이 있는지 검증하는 과정

- OpenAI GPT의 경우 API 형태로만 공개해서 사용 시 제약사항이 있었지만, LLaMA를 오픈소스로 풀어서 우리가 잘 쓰고 있는 중 (땡스투Meta)

- 아래에서 본격적으로 PoC를 진행하며 고려해야 됐던 사항들 설명되었다

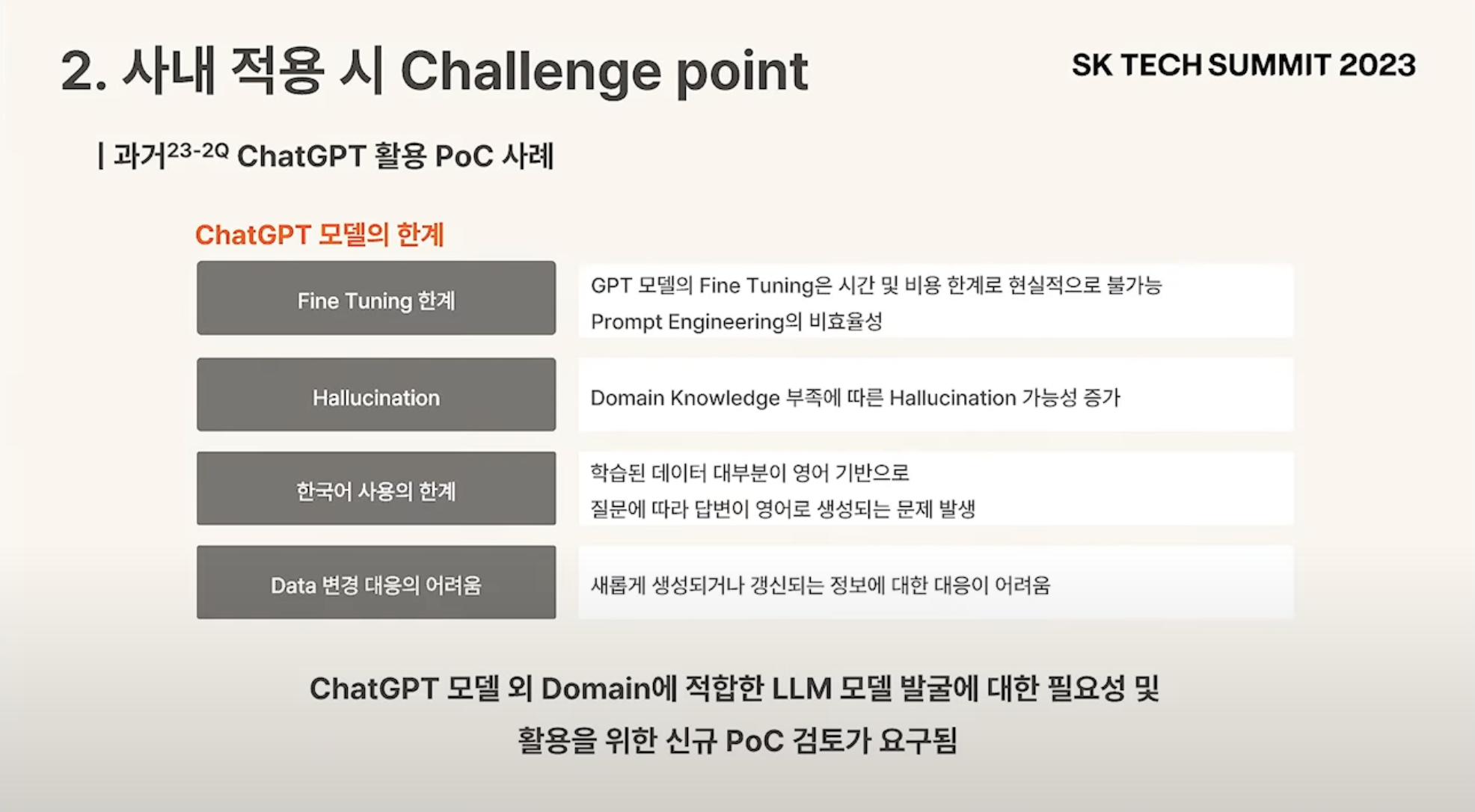

- Challenge Point

- ChatGPT (API 형태의 공개)

- 1. FT 한계

- 2. Hallucination

- 3. 한국어 성능

- 4. 변경되는 Data에 대한 어려움

- 그 외 공통적 문제점

- 1. 보안과 운영

- 2. 비용

- 3. Domain Adaptation

- ChatGPT (API 형태의 공개)

- 1. Opt-out 등으로 보안 지킬 수 있으나, 버전 업데이트 하면서 이전에 답변이 잘 생성되었던 게 이번엔 잘 안 될 수도 있는 문제 발생 가능

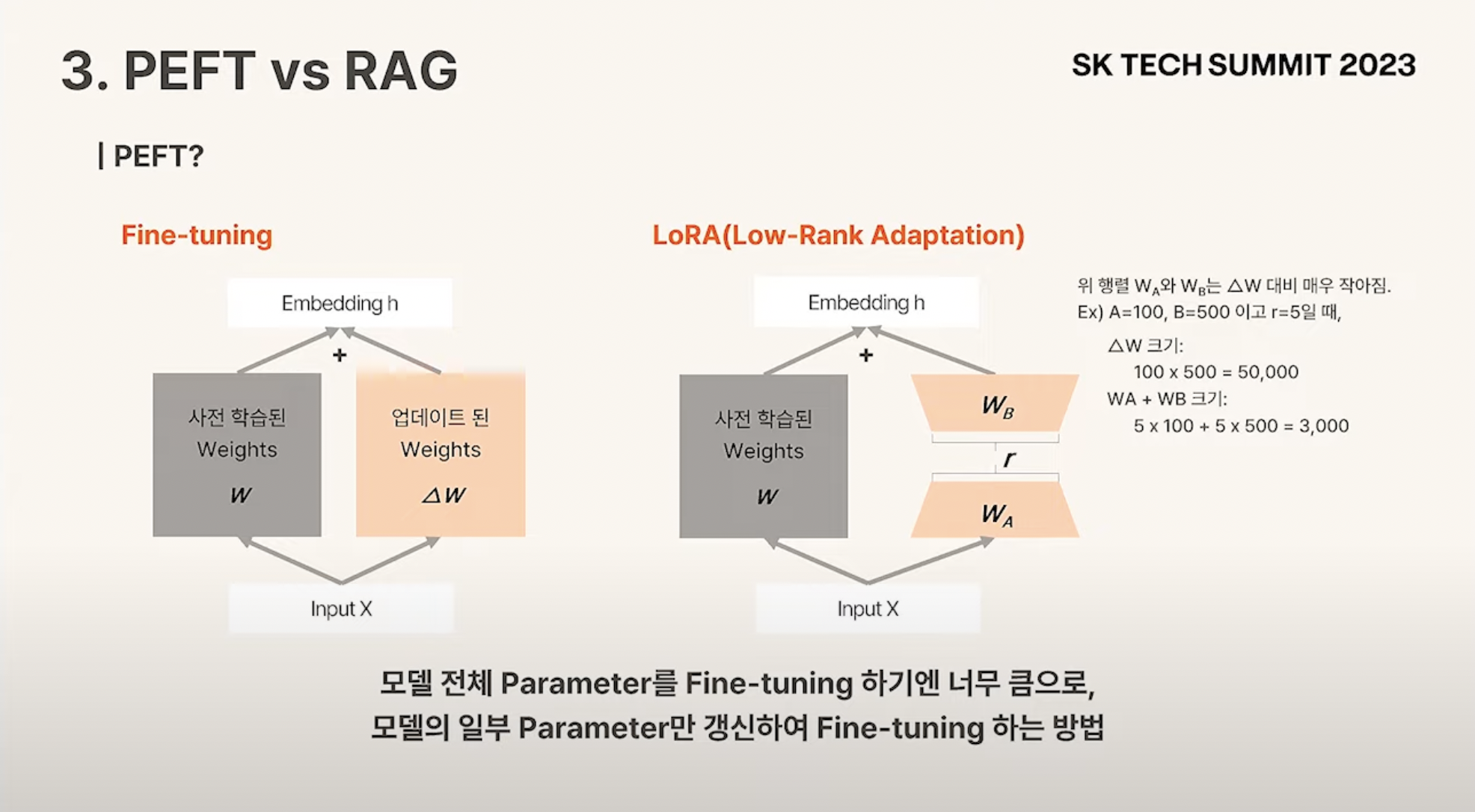

- 3. LLM은 Full FT 하기엔 너무 비용 소모적임

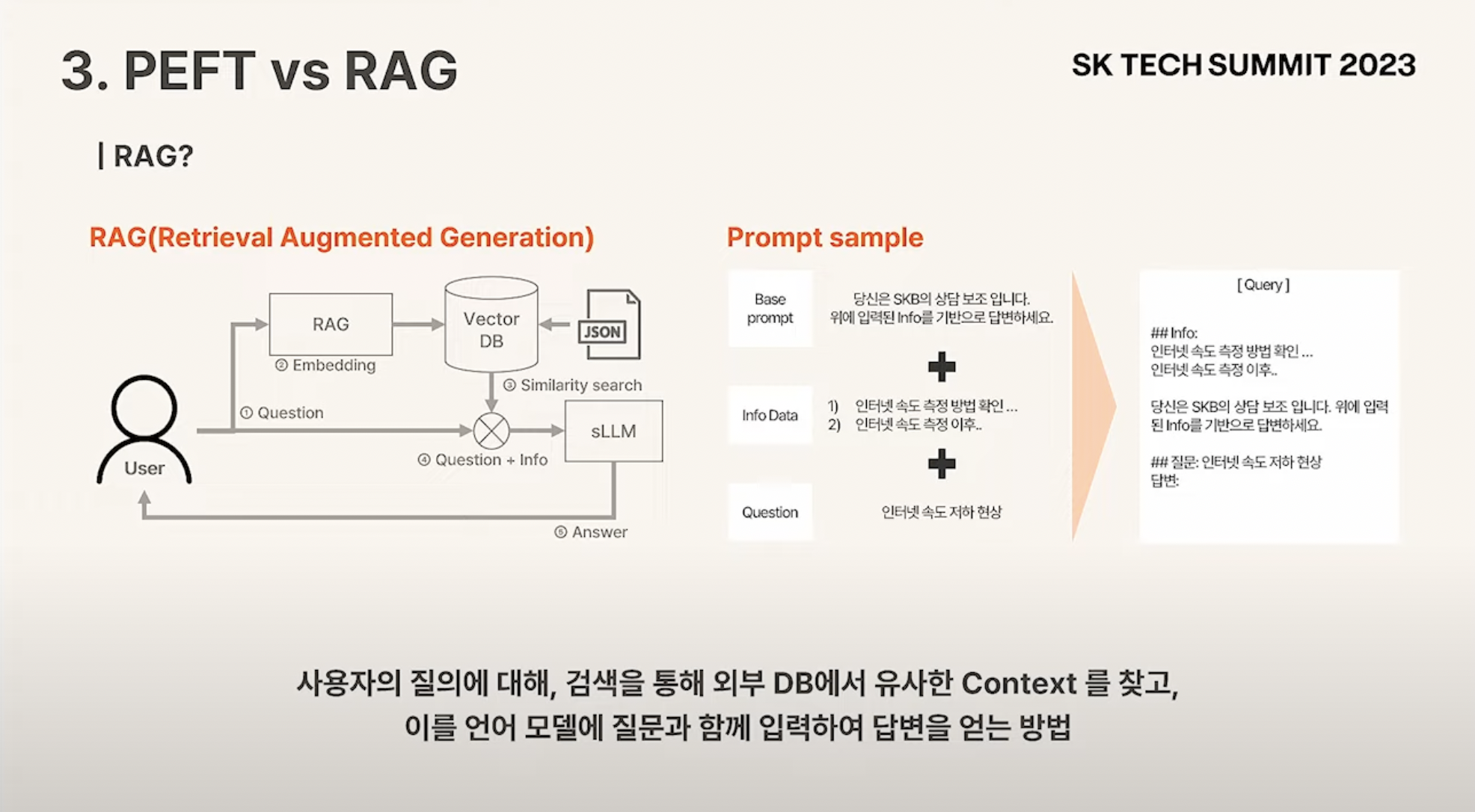

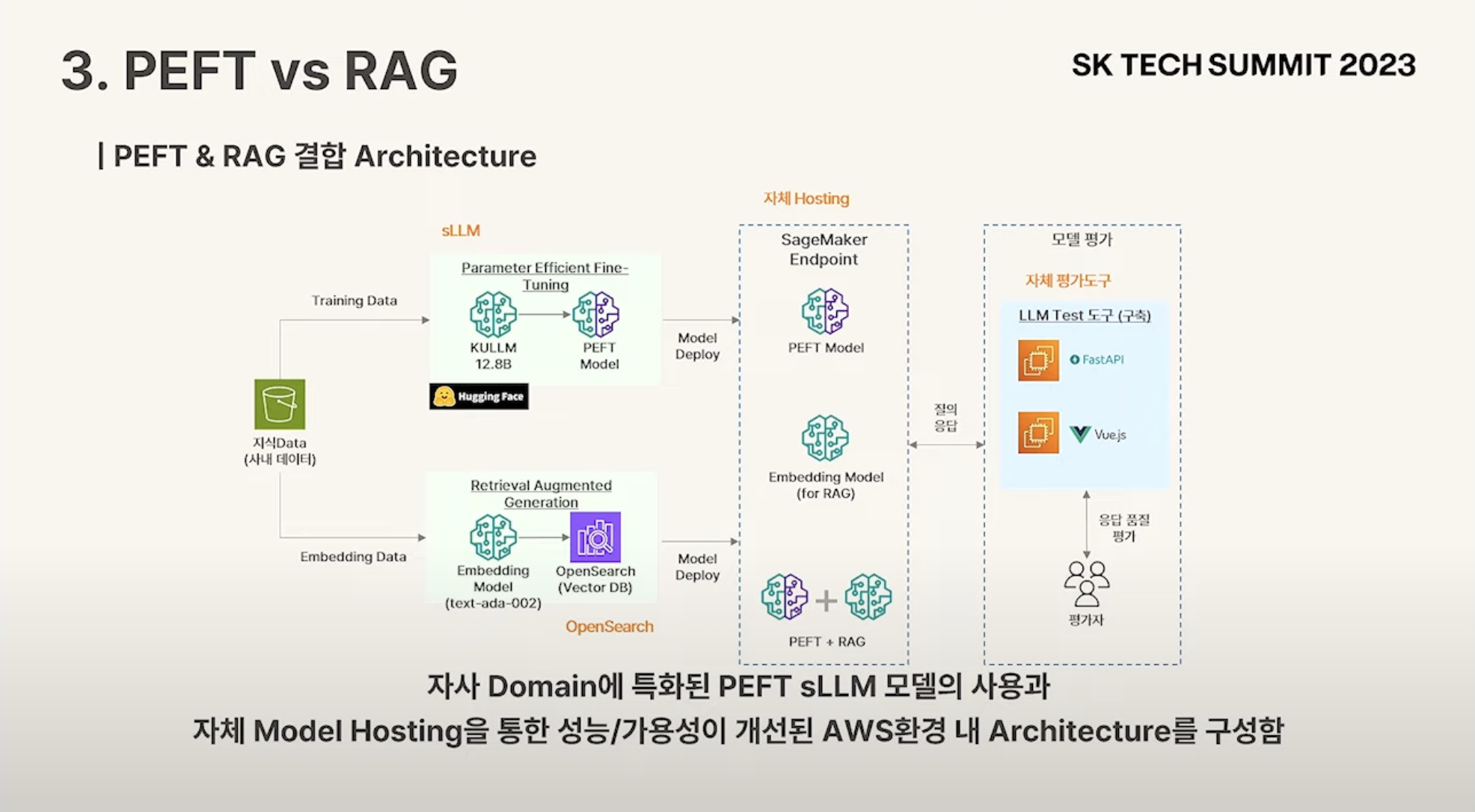

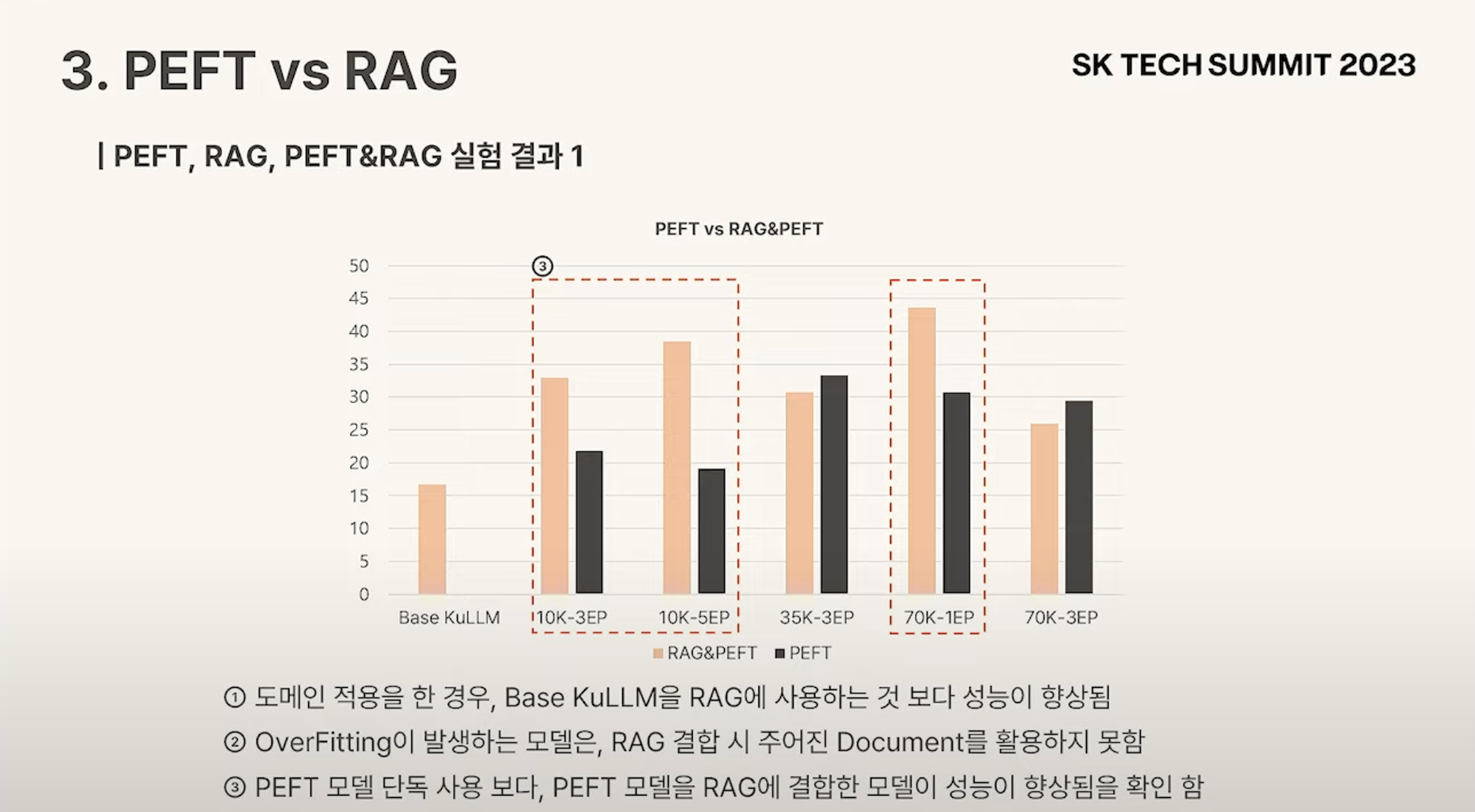

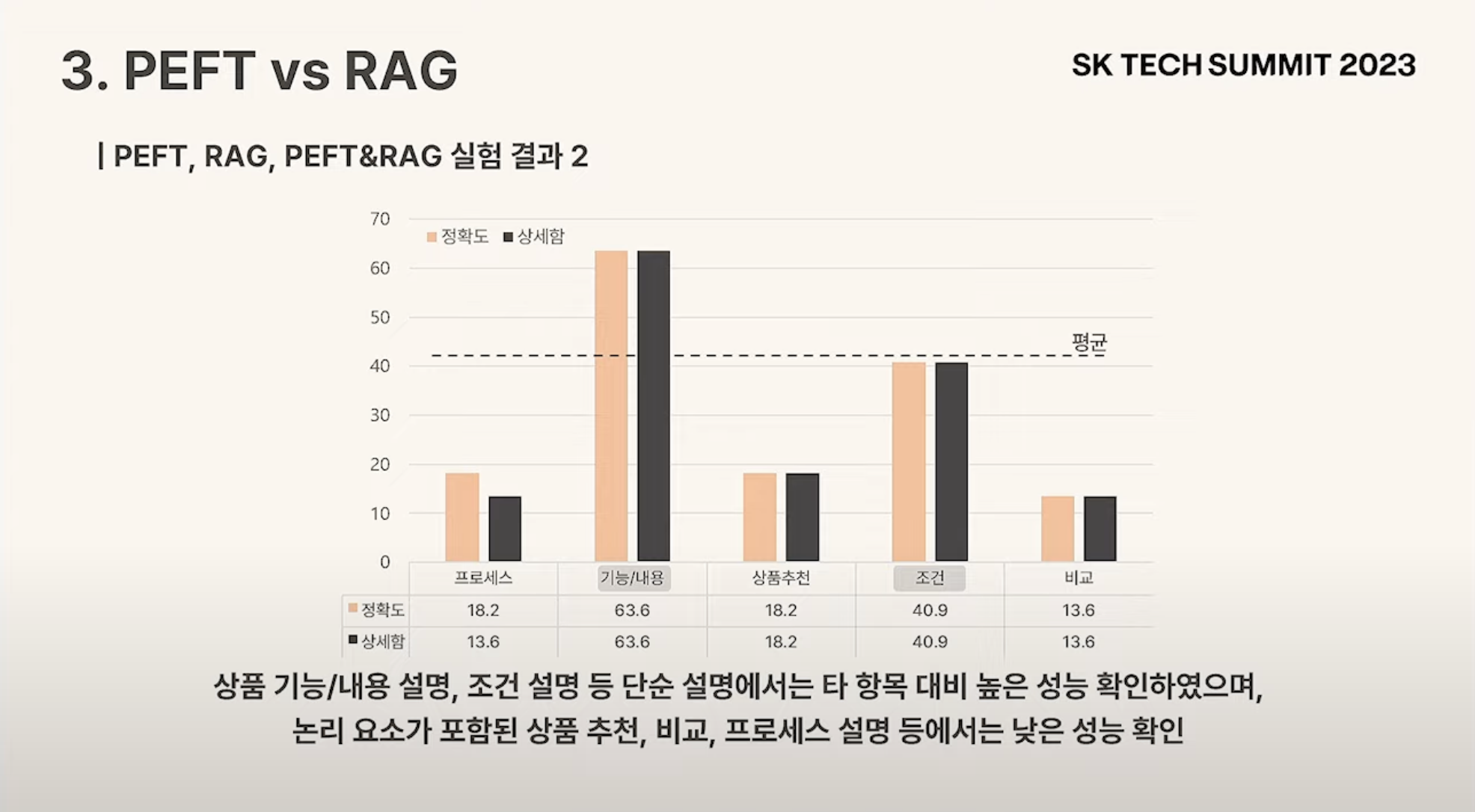

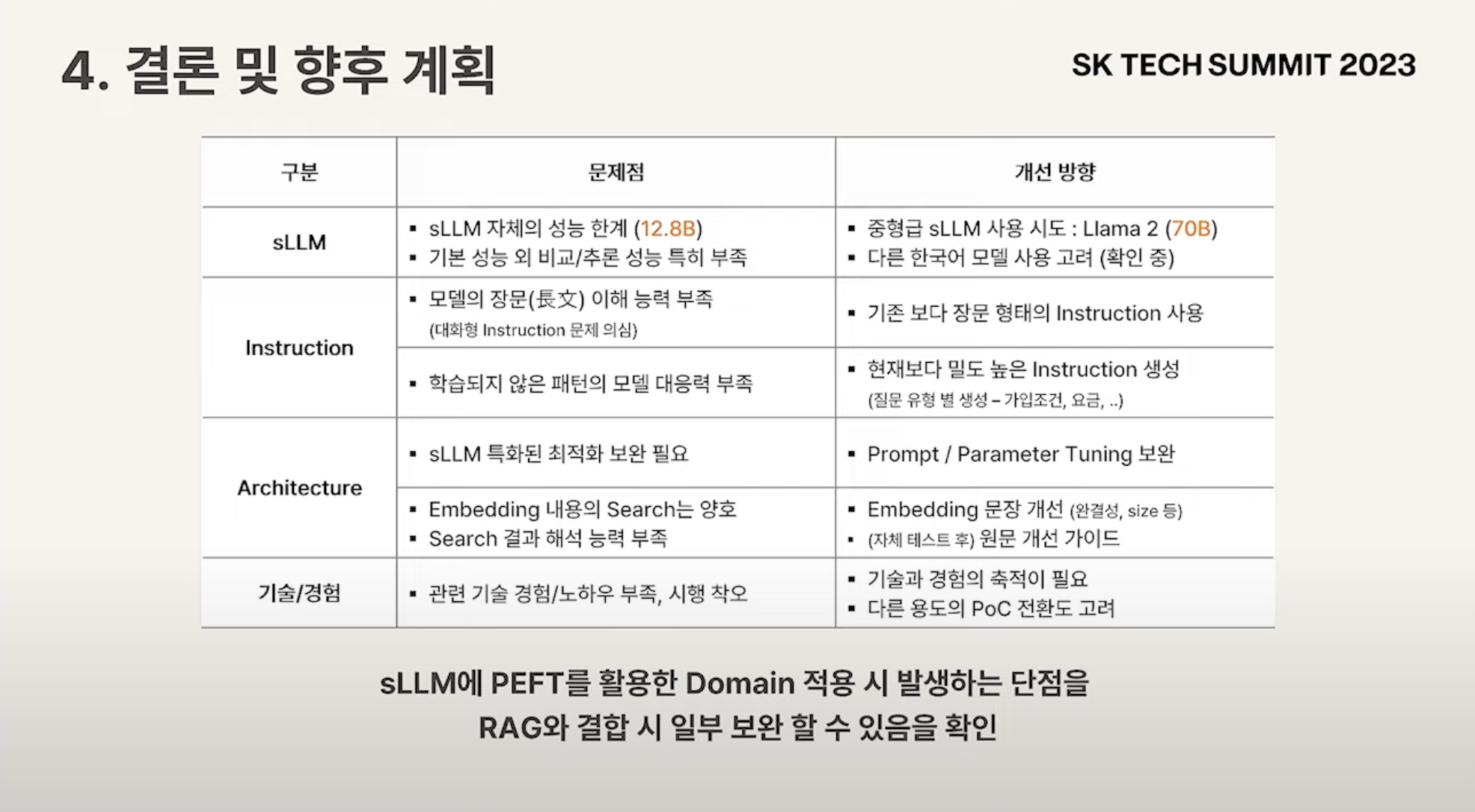

- 크게 PEFT와 RAG 두 가지로 검증 진행

- 아래는 PoC에 사용한 데이터와 전처리 과정 소개

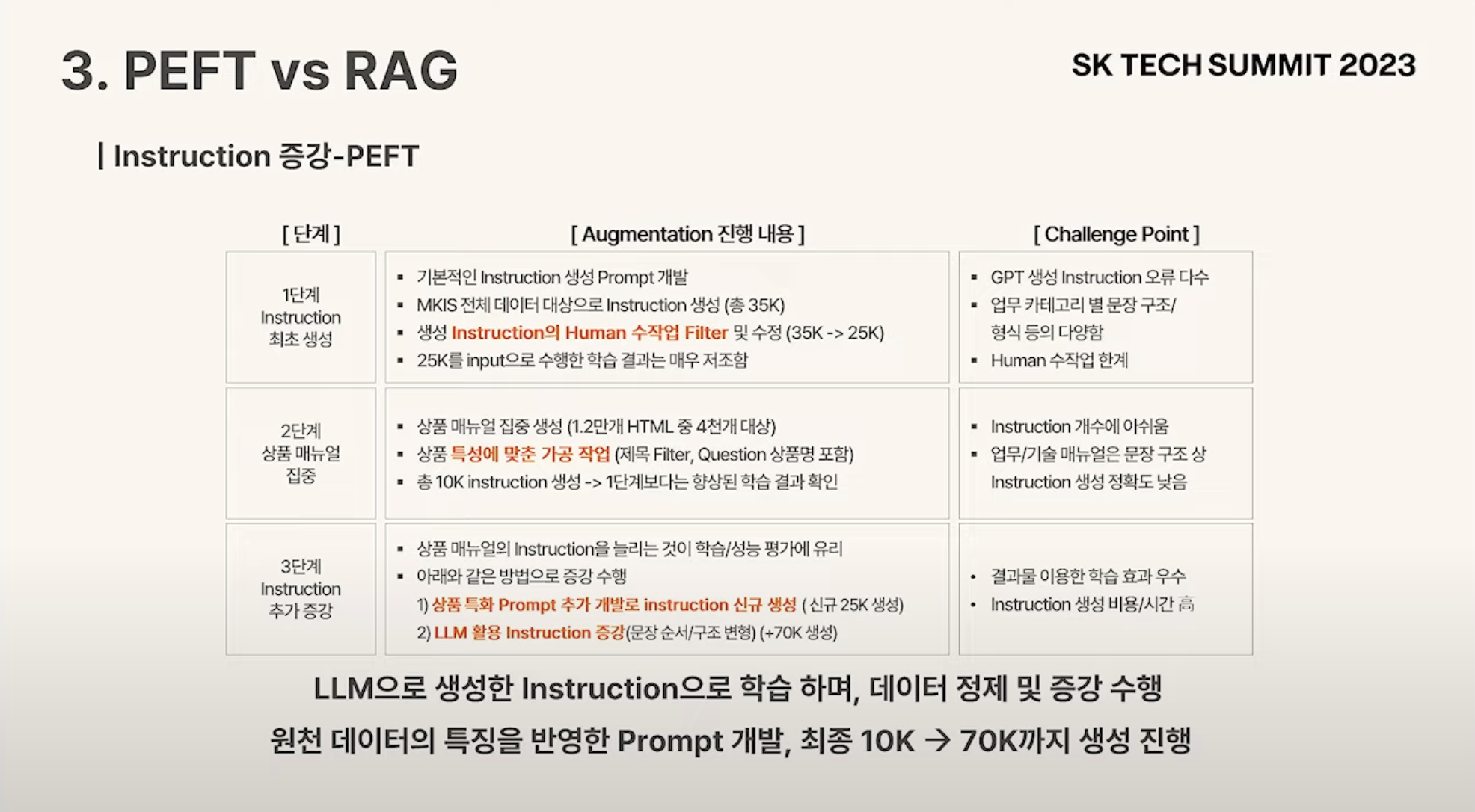

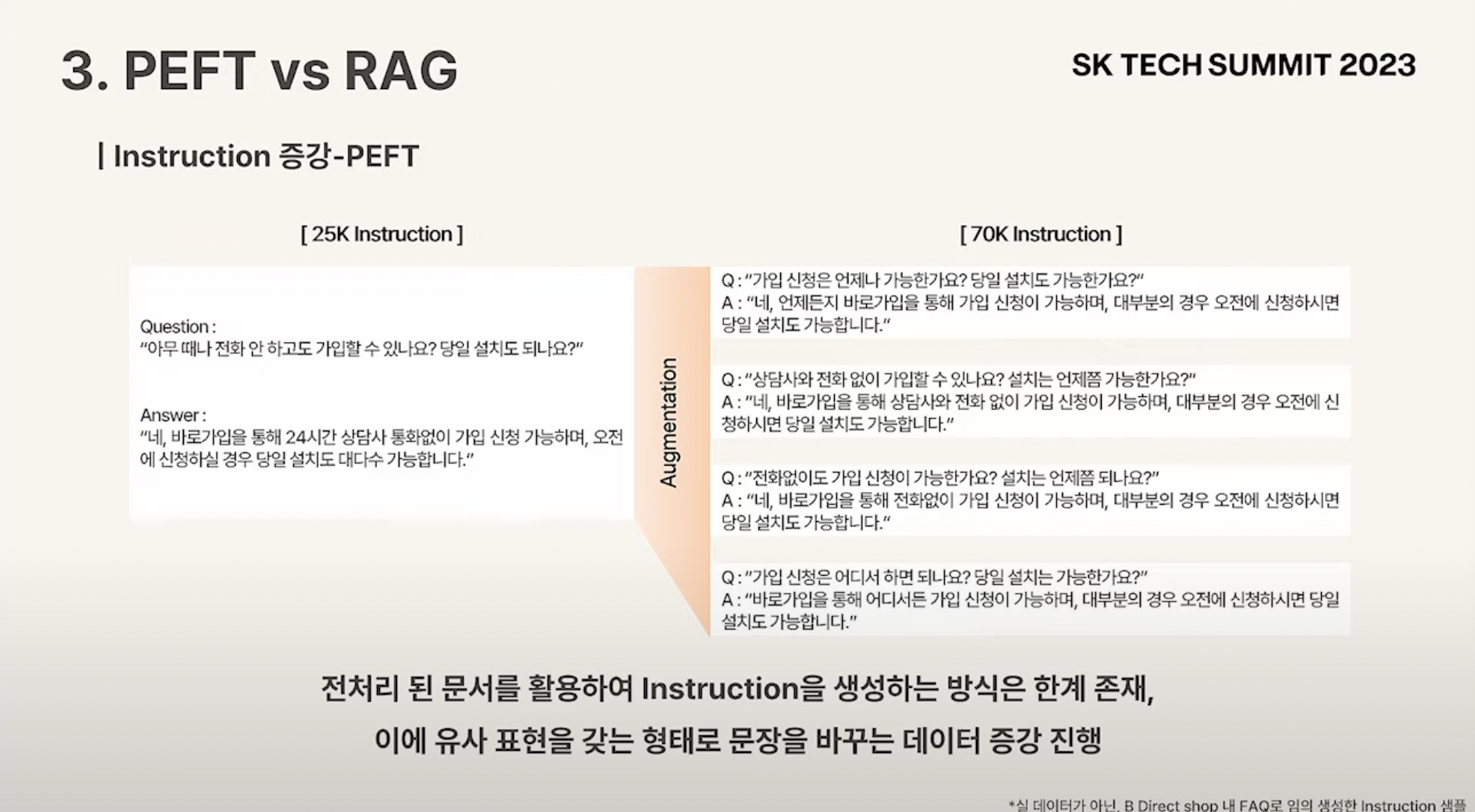

- PEFT 진행을 위해서 Instruction Set을 구성했던 단계들

- 1단계에서 생성한 25k의 데이터로 peft 했을 땐 성능이 저조했음

- 실험 단계에서는 KoVicuna-7B 제외

- 다른 베이스라인 모델들과는 파라미터 수에서도 차이가 있었기 때문

- 3~5 epoch 정도가 괜찮았고, 10epoch정도 도니까 Overfitting되는 경향 보임

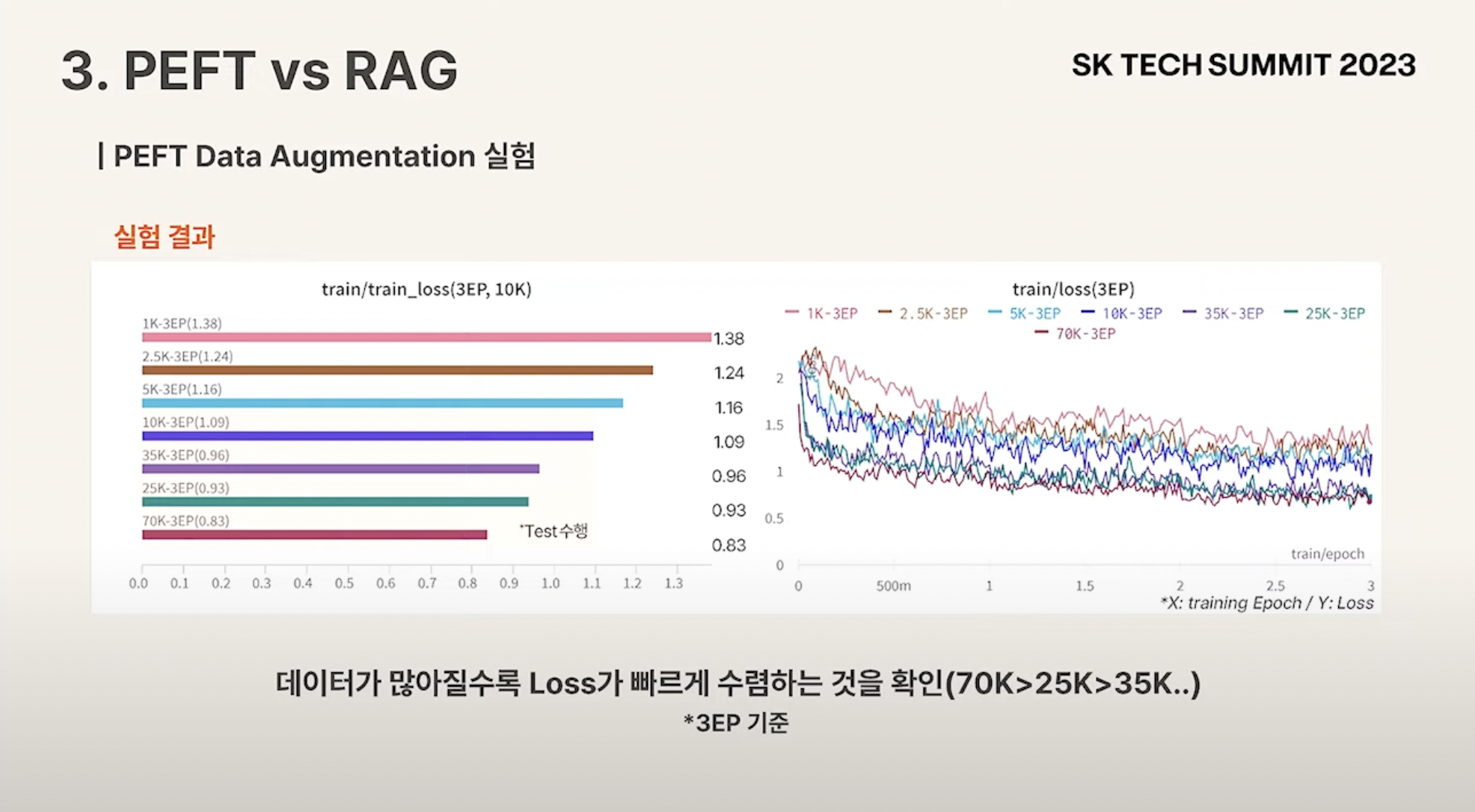

- Augmentation 하니까 Loss 더 빠르게 수렴하긴 함

- 하지만 생성 모델의 특성상 Loss가 낮다고 답변의 질이 좋은지는 확실하지 않으니, Case Study ㅇㅇ

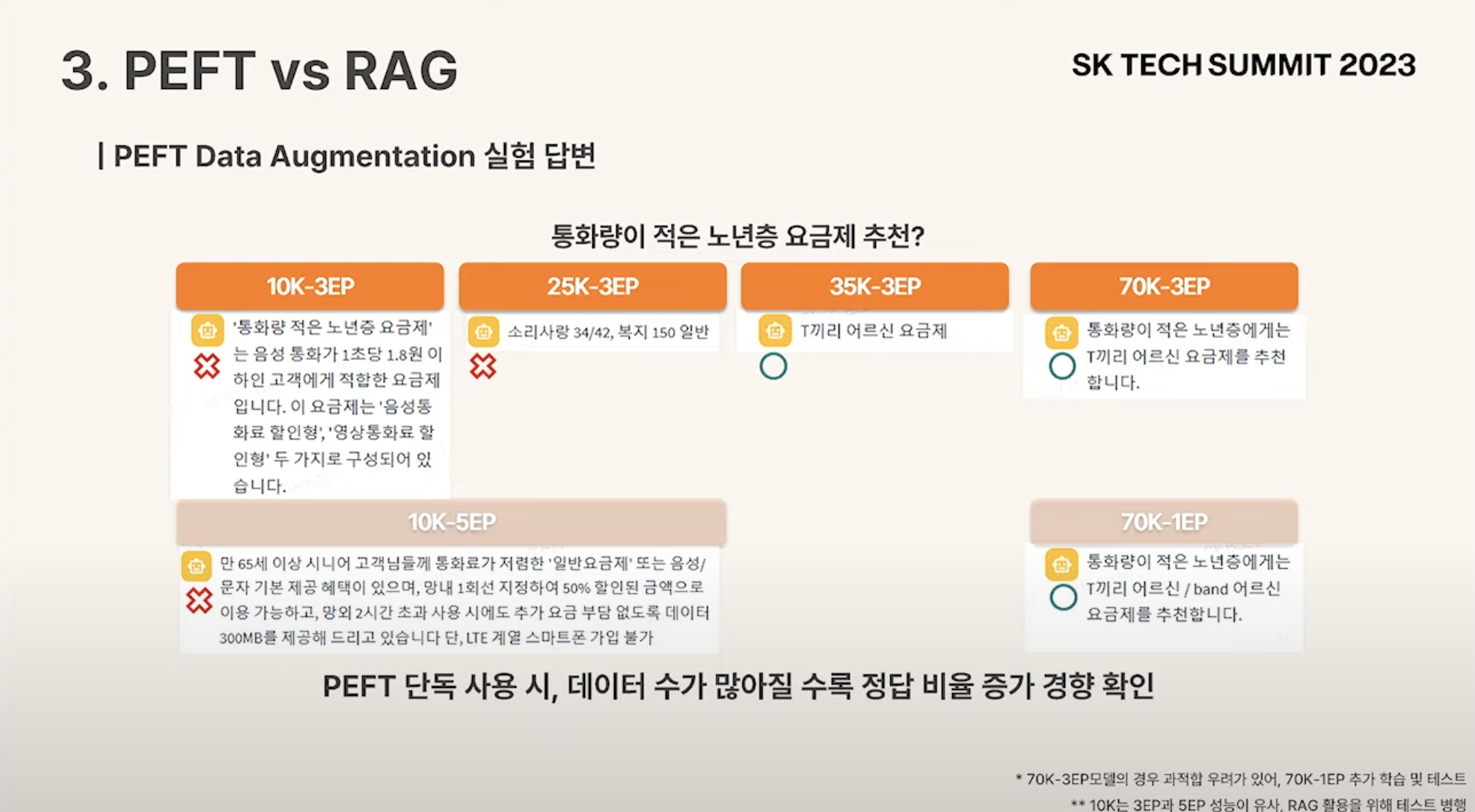

- 데이터가 많아질수록 정답 비율도 높아지더라 ~

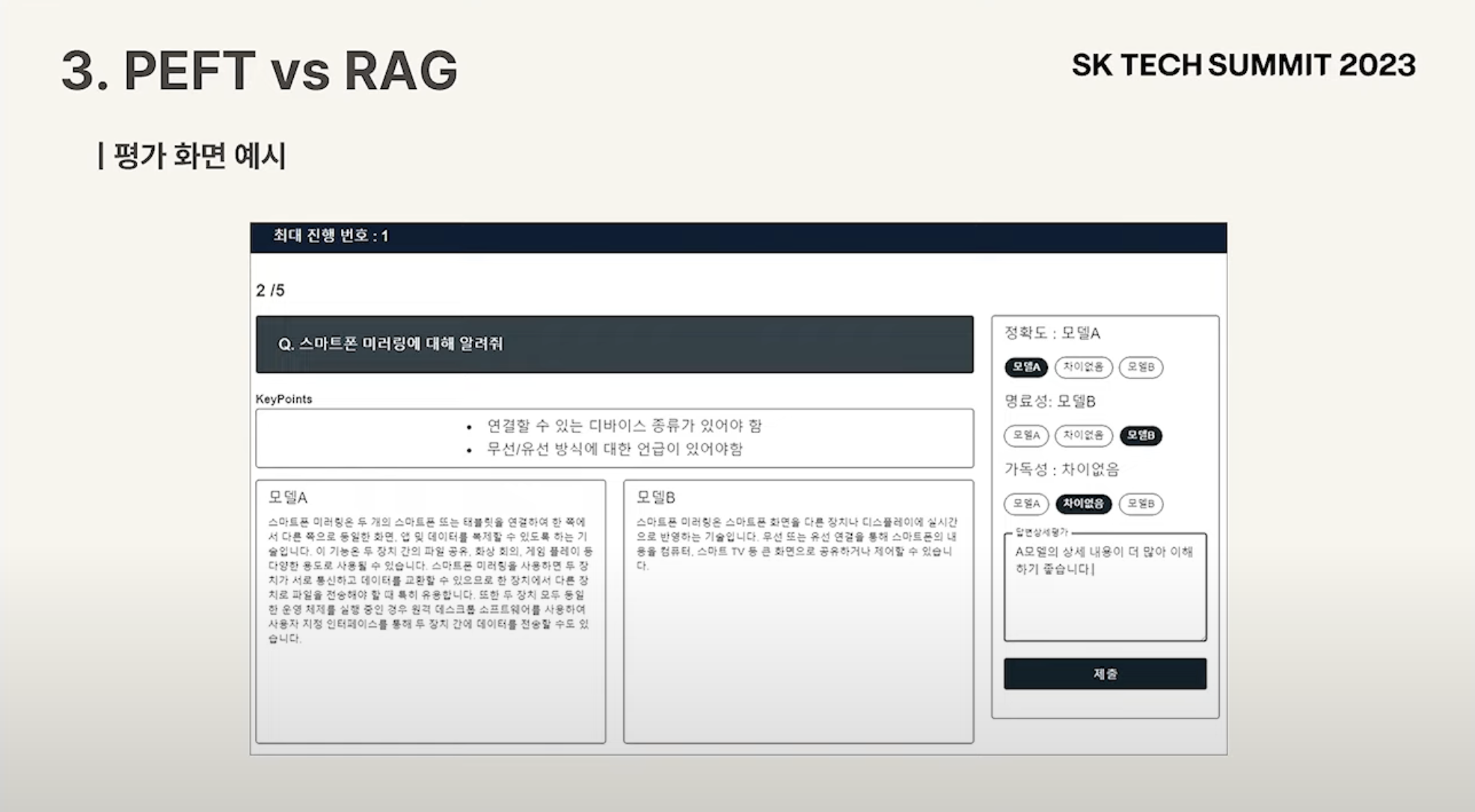

- 정성 평가 진행 ㅇㅇ

https://www.youtube.com/watch?v=WWaPGDS7ZQs

728x90'AI > NLP' 카테고리의 다른 글

- 목차